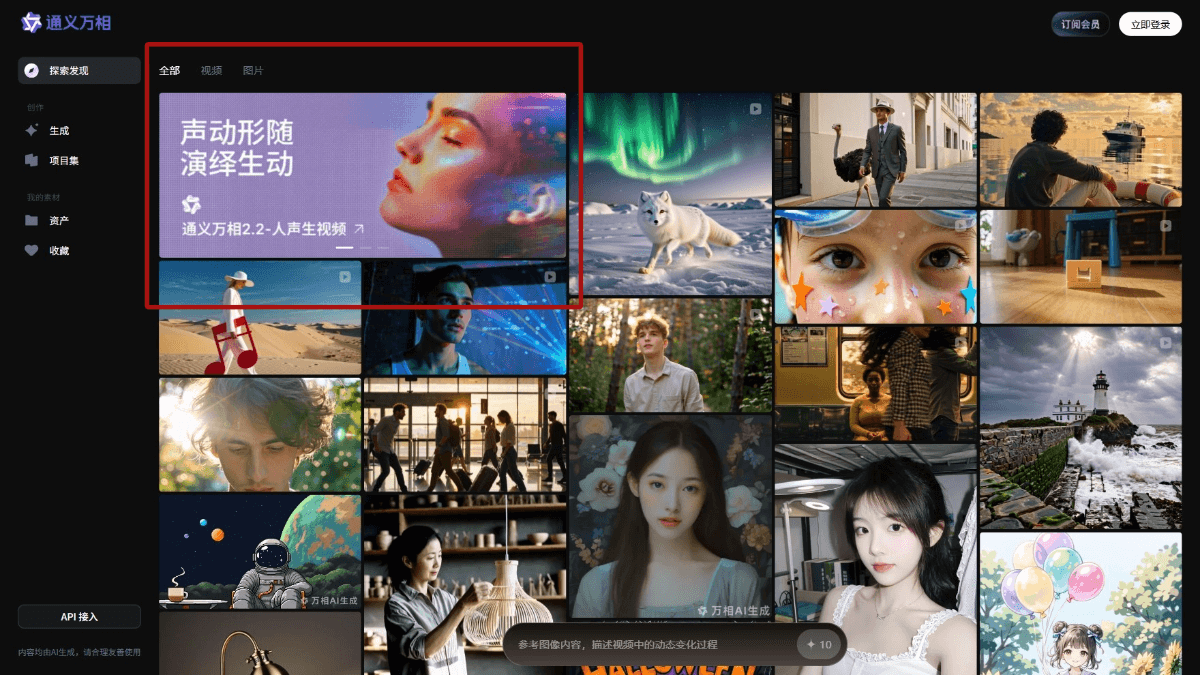

Wan2.2-S2V是什么

Wan2.2-S2V 是阿里通义开源的多模态视频生成模型,能用一张静态图片和一段音频生成高质量的数字人视频,视频时长可达分钟级。模型支持多种图片类型和画幅,包括真人、卡通、动物等,且支持通过文本提示控制视频画面,让画面更加丰富多样。模型融合多种创新技术,如音频驱动的细粒度局部运动控制和文本引导的全局运动控制,实现复杂场景的视频生成。Wan2.2-S2V 支持长视频生成和多分辨率训练与推理,满足不同场景的需求。Wan2.2-S2V 在数字人直播、影视制作、AI 教育等领域有广泛的应用前景。

Wan2.2-S2V的主要功能

- 视频生成:一张静态图片和一段音频,能生成高质量的数字人视频,支持多种图片类型和画幅,包括肖像、半身、全身等。

- 文本控制:用户通过输入文本提示能控制视频画面,让视频内容更加丰富和个性化,提升视频的创意和表现力。

- 长视频生成:基于层次化帧压缩技术,生成稳定的长视频,满足数字人直播、影视制作等场景的需求。

- 多分辨率支持:支持不同分辨率的视频生成,适应多样化应用场景,提升视频的通用性和灵活性。

- 多类型图片支持:支持驱动真人、卡通、动物、数字人等多种类型图片,适用范围广泛,为内容创作提供更多可能性。

Wan2.2-S2V的官网地址

- 项目官网:https://tongyi.aliyun.com/wanxiang/

- HuggingFace模型库:https://huggingface.co/Wan-AI/Wan2.2-S2V-14B

Wan2.2-S2V相关的人工智能知识

- 多模态融合技术:多模态融合技术是将多种模态的数据(如文本、图像、音频等)结合起来进行处理和分析。Wan2.2-S2V 用多模态融合技术,将静态图片、音频和文本提示相结合,生成高质量的数字人视频,充分利用不同模态数据的优势,提升视频生成的准确性和丰富性。

- 音频驱动技术:音频驱动技术是通过音频信号控制视频生成中的动作和表情。Wan2.2-S2V 用音频驱动技术,根据输入音频的节奏和内容生成自然流畅的视频动作,使数字人视频更加生动和真实。

- 文本控制技术:文本控制技术支持用户通过输入文本提示控制视频生成的具体内容。在 Wan2.2-S2V 中,用户通过文本提示调整视频的背景、动作和表情等,实现更个性化和精准的视频生成,满足多样化的创作需求。

- 层次化帧压缩技术:层次化帧压缩技术是用在处理长视频生成的技术。Wan2.2-S2V 通过层次化帧压缩技术,能高效地处理长视频生成中的帧数据,确保视频的稳定性和流畅性。

- 多分辨率训练与推理:多分辨率训练与推理是模型在不同分辨率下进行训练和推理的能力。Wan2.2-S2V 支持多分辨率训练与推理,根据不同的应用场景生成不同分辨率的视频,提高模型的灵活性和通用性,适应多种不同的应用需求。

相关文章

暂无评论...